2025年最值得关注的开源开发工具与框架

2026-04-21

前言

开源生态在2024-2025年迎来了爆发式增长。AI 浪潮推动了大量创新工具涌现,本文精选了今年最值得关注的几类开源项目,帮助开发者在工具选型时不走弯路。

一、AI / LLM 推理框架

1. Ollama — 本地大模型运行神器

Ollama 是今年最火的本地大模型运行工具,支持一键启动 Llama 3、Qwen、Mistral、Gemma 等主流模型。零配置,本地运行,API 兼容 OpenAI,直接替换成本地端点。

# 3秒启动一个大模型

ollama run llama3

适用场景:个人开发者实验、AI 功能原型、隐私敏感数据处理。

2. vLLM — 生产级 LLM 推理引擎

如果你需要高吞吐量的模型服务,vLLM 是首选。PagedAttention 技术让显存利用率提升数倍,支持 Tensor Parallel 分布式推理,是国内大多数 AI 应用公司的标配。

适用场景:需要对外提供模型 API 服务的企业级应用。

二、Web 框架

3. Hono — 极速边缘框架

Hono 是一个轻量、极速的 Web 框架,支持 Cloudflare Workers、Deno、Bun、Node.js 等所有 JS 运行时。API 设计简洁,性能在 Techempower 基准测试中一骑绝尘。

import { Hono } from 'hono'

const app = new Hono()

app.get('/', (c) => c.text('Hello Hono!'))

export default app

为什么火:体积小(压缩后仅 14KB)、兼容性强、边缘部署零成本。

4. Bun — 全能 JavaScript 运行时

Bun 不仅仅是一个 Node.js 替代品,它集成了打包器、转译器、包管理器,号称"一体化"解决方案。2025年1.2版本稳定后,越来越多的项目开始迁移到 Bun。

# 比 npm 快 10 倍的安装速度

bun install

# 内置 TypeScript 支持,无需额外配置

bun run index.ts

三、前端工具链

5. shadcn/ui — 不是组件库,是你的代码

shadcn/ui 不是传统的 npm 包,它是" copy-paste 到你项目里"的组件代码。每一个组件都是你自己项目的一部分,你可以自由修改样式和逻辑。

配合 Radix UI 和 Tailwind CSS,是目前最受欢迎的中台/管理后台 UI 方案。

优势: - 代码属于你,不是依赖 - 升级无需等待库更新 - 组件设计极其精致

6. Tailwind CSS v4 — 下一代 CSS 框架

Tailwind v4 换用了 Lightning CSS 作为底层,编译速度提升 10 倍以上。新的 CSS-native 配置方式让开发体验更加流畅。

四、数据库与存储

7. Turso — 边缘 SQLite

Turso 将 SQLite 分布到全球数百个边缘节点,读取延迟降到毫秒级。免费额度足够个人项目使用,是 Serverless 场景下传统 PostgreSQL 的轻量替代。

8. RisingWave — 流式数据库新星

RisingWave 是新一代流处理数据库,用 SQL 处理实时数据流。支持 Flink 类似的流处理能力,但学习成本更低,是实时分析场景的热门选择。

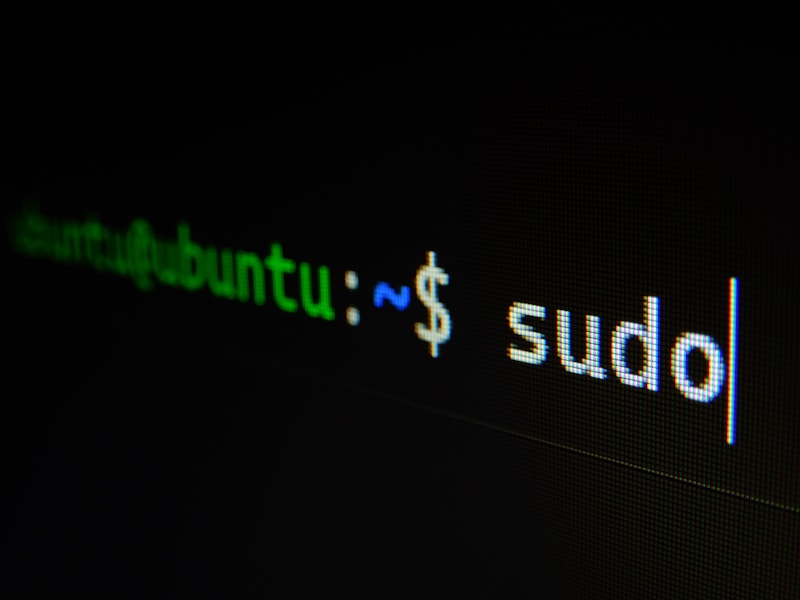

五、DevOps 与部署

9. Coolify — 开源自托管 PaaS

Coolify 让你在自己的服务器上搭建类似 Heroku/Vercel 的平台。Git 推送自动部署,Docker 一键配置,完全开源无需担心供应商锁定。

# 5分钟搭建自己的 PaaS

curl -L https://coolify.io/install | bash

10. Podman — Docker 的无守护进程替代

Podman 提供与 Docker 完全兼容的 CLI,但不需要 root 权限运行的守护进程。2025年越来越多的企业开始用 Podman 替代 Docker 作为默认容器运行时。

六、开发效率工具

11. Warp — 21世纪的终端

Warp 是用 Rust 编写的现代终端,内置 AI 自动补全、命令块编辑、协作分享等功能。虽然不完全开源,但其核心 CLI 工具已开源。

12. Zed — GPU加速代码编辑器

Zed 是 Atom 创始团队的新作,用 Rust + GPU 加速打造超快编辑体验。支持 VS Code 插件,2025年正式版发布后口碑爆棚。

七、总结与选型建议

| 场景 | 推荐工具 | 理由 | |------|---------|------| | 本地跑大模型 | Ollama | 零配置,体验最佳 | | 模型生产服务 | vLLM | 高吞吐量,业界标配 | | Web API 开发 | Hono | 极速,边缘友好 | | JS 运行时 | Bun | 一体化,提速明显 | | 中台 UI | shadcn/ui | 代码自有,设计精致 | | 自托管部署 | Coolify | 开源 PaaS,自由度高 | | 数据库 | Turso / RisingWave | 边缘/流处理各有优势 | | 容器化 | Podman | 无 daemon,更安全 |

写在最后

开源社区的活力远超商业公司的迭代速度。以上这些工具大多数都经过了大量生产环境验证,选择时只需要结合自己项目的实际需求即可。

你最看好哪一个?欢迎留言讨论!

本文首发于我的技术博客,转载需授权。

0 Comments latest

No comments.